せっかくStable DiffusionのパッケージマネージャーStability Matrixを導入したので、パッケージの追加が簡単にできるものなのか試してみた。

導入手順

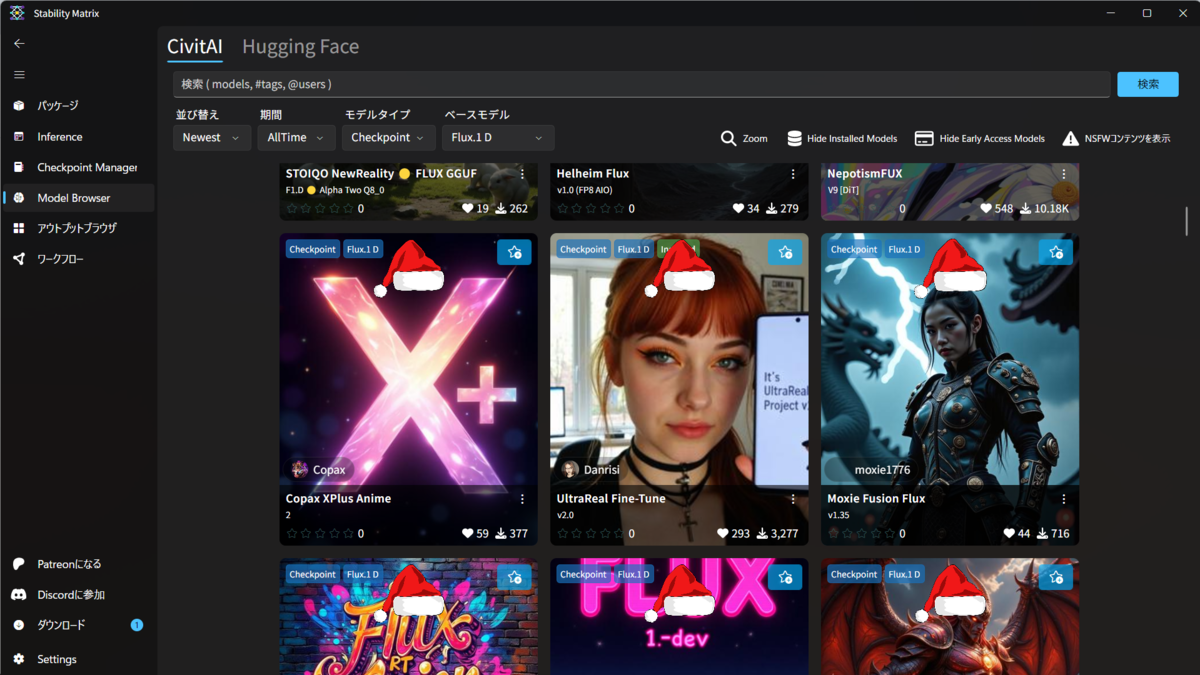

まず、「Model Browser」から適当に「UltraReal Fine Tune」というモデルを選んでダウンロードした。

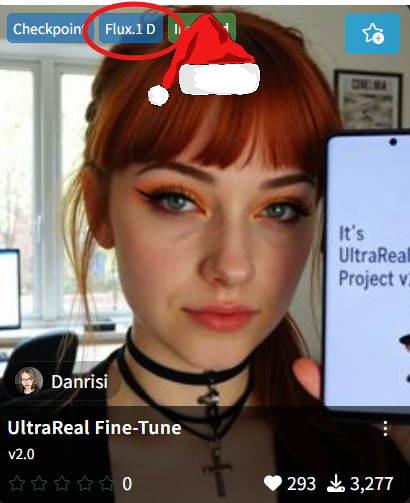

ダウンロードしてよく見ると「Flux.1 D」と表示されている。「FLUX.1」という画像生成モデルらしい。

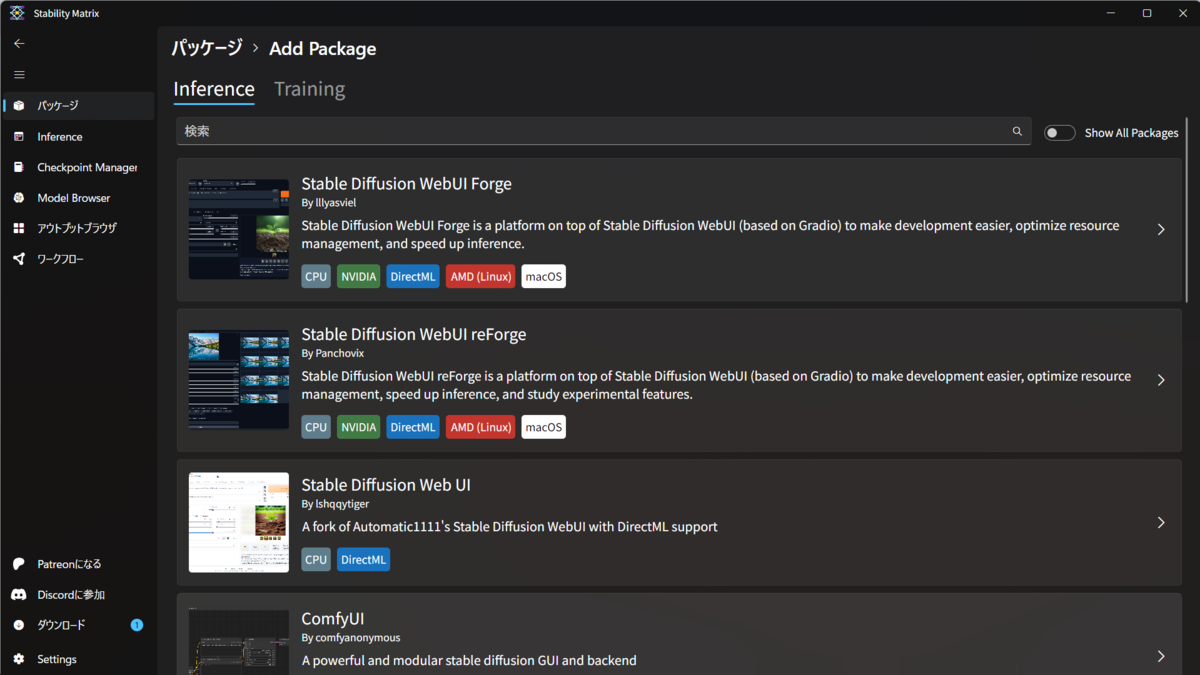

FLUX.1が動くUIとしてStable Diffusion WebUI Forgeがあるらしいので、パッケージ画面から該当するパッケージを追加した

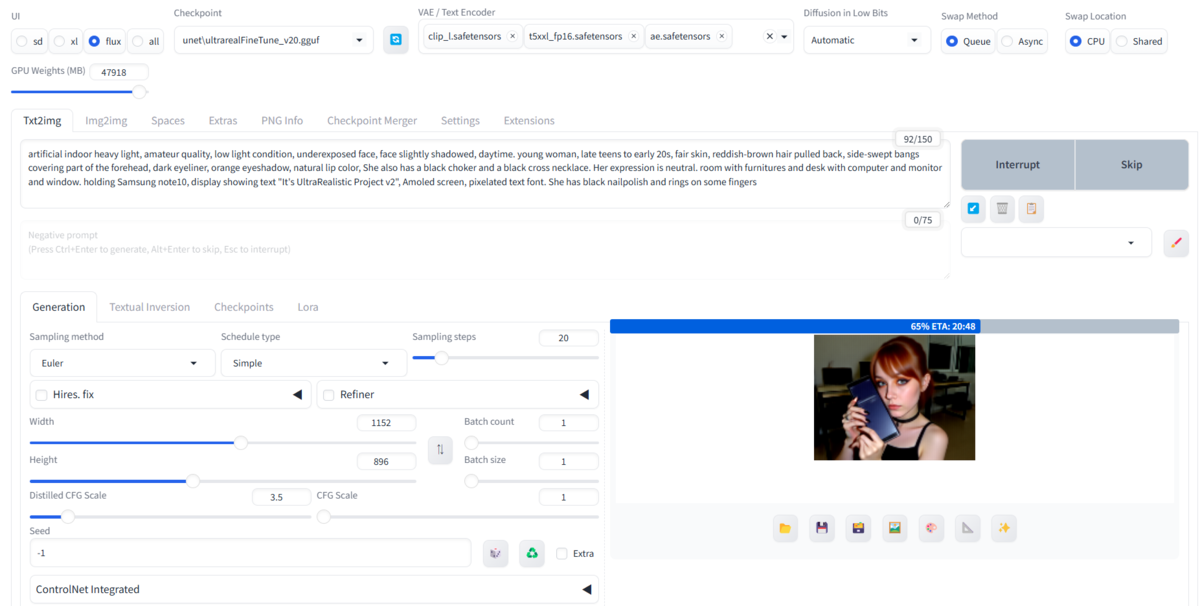

パッケージの設定画面で「Skip Torch CUDA Test」と「Always CPU」にチェックを入れてから起動(Launch)する。

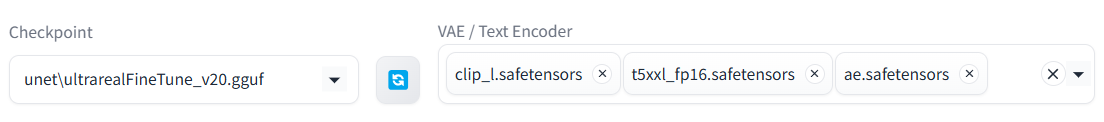

起動するとUIがブラウザに立ち上がる。Checkpoint欄とVAE/TexteEncoder欄に以下のファイルを設定する。

- Checkpoint

- ultrarealFineTune_v20.gguf

- VAE/Encoder

- clip_l.safetensors

- t5xxl_fp16.safetensores

- ae.safetensors

VAE/Encoder欄にはこれら3つを指定しないとエラーが出る。例えばclip_l.safetensoresを指定しないと「AssertionError: You do not have CLIP state dict!」と言った感じ。エラーが出て初めて別のファイルが必要だと気付くので、この辺りはパッケージマネージャーが必要なファイルをダウンロードしてくれるか、指示してもらいたいところだ。まあネットで検索すれば何とかなるのだが。。

実行結果

最終的には以下のように条件設定することで画像を生成することができた。

プロンプトはこちらのサイトにあったものをそのまま貼り付けた。プロンプトをGoogle翻訳すると以下のようになる。

人工的な室内の強い光、アマチュア品質、低照度条件、露出不足の顔、顔がわずかに影になっている、昼間。若い女性、10代後半から20代前半、色白、赤みがかった茶色の髪を後ろにまとめ、額の一部を覆っているサイドに流した前髪、濃いアイライナー、オレンジ色のアイシャドウ、自然な唇の色、彼女は黒いチョーカーと黒い十字架のネックレスをしています。彼女の表情は無表情です。家具とコンピューターとモニターと窓のある机のある部屋。Samsung Note10を持っており、ディスプレイには「It's UltraRealistic Project v2」というテキストが表示されています。Amoledスクリーン、ピクセル化されたテキストフォント。彼女は黒いマニキュアを塗っており、いくつかの指に指輪をしています。

生成された画像がこちら。生成時間はCPUで約52分。

まとめ

パッケージマネージャーを使うことで比較的容易に新しい画像生成AIを使うことができた。様々なパラメータの意味は全くわからないが、とりあえずプロンプトをコピペして実行したら、プロンプト指示通りの画像が生成された。素晴らしい。

動画生成の場合もそうであったが、プロンプトは映画やドラマの脚本のような文章だ。以前はこのような脚本をもとに、優秀な映像作家や映画監督だけが映像、動画を作成することができたわけだが、今は私のようなど素人でも簡単に映像を作ることができるようになった。すごい時代である。