LM-Studioでローカル環境でAIエージェントを試してみた。今回はこいつを動かすための導入手順を主にメモしておく。

内容的にはshi3z氏の記事の通りで特に難しくはないのだが、導入時に私のように道に迷う人もいると思うので、道しるべとして残しておきたい。

わずか2.5GBの衝撃!ご家庭でPerplexityみたいなものが動くヨ!みんなもうコレにしようぜ|shi3z

導入手順

Ubuntu環境でもWindows環境でも手順はほぼ同じである。

- Serper API KEYの取得

Serper - The World's Fastest and Cheapest Google Search API

上記サイトにアクセスしてID登録してAPIキーを取得する。APIキーをメモしておく。 - Serper-MCPサーバーを立てる(→Node.jsの導入)

GitHub - marcopesani/mcp-server-serper: Serper MCP Server supporting search and webpage scraping

私はここで躓いた。上記サイトはmcp-server-serperのGitHubのサイトであるが、何をすればいいのかよく分からなかった。結局私の理解ではSerper-MCPサーバーはLM-Studioの中に実装されており、それを動かすための環境としてNode.jsの導入が必要ということなのだと思う。

・Windows環境でのNode.jsの導入は下記ページからWindowsインストーラをダウンロードして実行する。Dockerを使うインストール方法もある。その方がバージョン管理はしっかりできるのだろうが、私はDockerを使いたくなかったのでWindowsインストーラを使用した。・Ubuntu環境でのNode.jsの導入は下記の記事を参考にしてほしい。

- LLMモデルをダウンロード

・LM-Studioを立ち上げて適当なモデルをダウンロードする。

・shi3z氏の記事ではjan-v1-4bを使用しているが、後述するようにこれ以外のモデルでもAIエージェントは動かせる。 - MCPの設定

・モデルを選択し、Context-lengthをエラーが出ない範囲で最大にしてロードする。

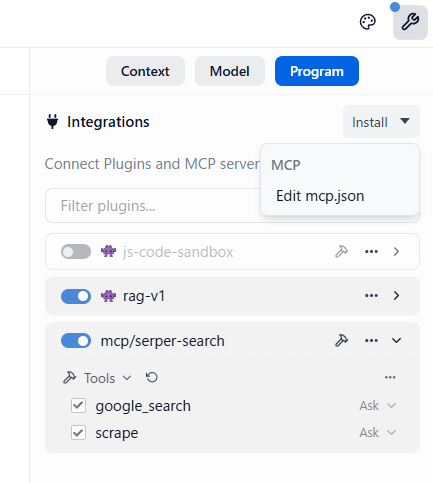

・Chat画面の右端にあるProgramを押し、「Edit mcp.json」を選ぶ。

・画面に「mcp.json」のタブが開くので以下のように入力する。

{ "mcpServers": { "serper-search": { "command": "npx", "args": ["-y", "serper-search-scrape-mcp-server"], "env": { "SERPER_API_KEY": "ここにSerperのAPIキーを入れる" } } } }

・「mcp/serper-search」のスイッチがオフになっているのでオンにし、google-searchとscrapeのチェックボックスがチェックされていることを確認する。(この操作が「Serper-MCPサーバーを立てる」処理ではないかと私は理解している)

- 再立ち上げ

・LM-Studioを立ち上げ直す。

・モデルを再ロードする。Context-lengthをできる限り最大にする。

・例えば「今日の主要なAIニュースについて調べて10個ほどそれぞれまとめて。」と聞いてみる。

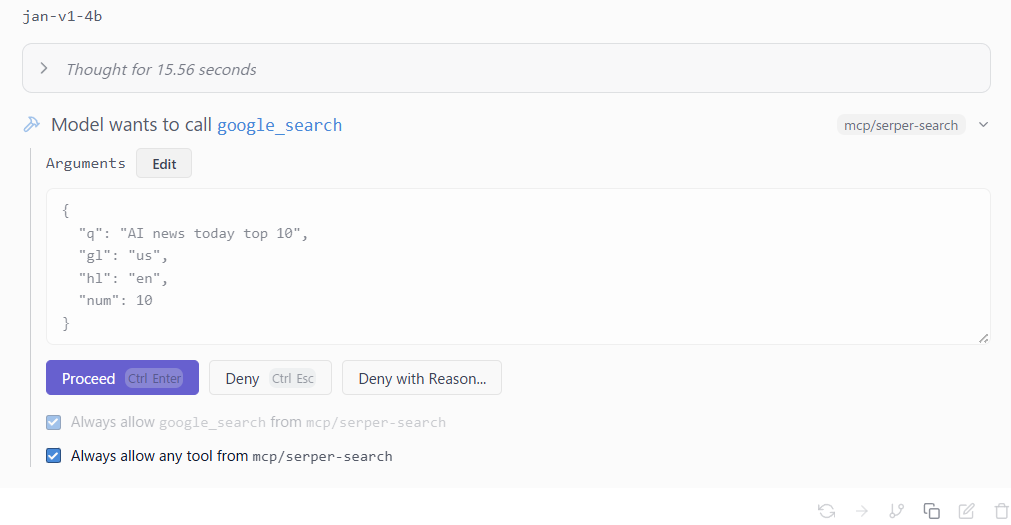

・順調にいけばモデルが考え始め、以下のように確認してくる。

・always allowをチェックしてProceedボタンを押す。

とりあえず上記手順で私の環境(Windows環境とUbuntu環境)で動いているので、導入手順としては多分間違っていないはずだ。

実行結果

以下のように聞いてみた。使用したモデルは”Jan-v1-4B”である。

今日の主要なAIニュースについて調べて10個ほどそれぞれまとめて。

しばらく考えて最終的に以下の回答が表示された。私の環境で約8分ほどかかった。

以下は、今日の主要なAIニュースを10個まとめたものです:

- Googleがセキュリティチーム向けAIソリューションを新規に発表

Google CloudがAI技術を活用したセキュリティ支援ツールを導入し、企業の脅威対応効率を向上させる。- MetaがAI関連採用を一時停止

Metaは大規模なAI投資後、内部のAI関係者採用を一時的に停止したと報じられた。- GMがシリコンバレーにAI開発チームを拠点移転

GMがAI技術の研究開発を加速するため、シリコンバレーへの新規チーム設置を発表。- NvidiaのBlackwellチップが中国市場でリードを狙う

新しいBlackwellチップは中国向けのAIモデルに特化し、既存のH20モデルを超える性能を示すと予測される。- 大手テクノロジー企業、AIデータセンターで電力コスト上昇

AmazonやGoogleが増加するAIデータセンター運用により、個人・小規模ビジネスの電力料金に影響が出ている。- 企業がAI投資を急増中だが実益は少ない

企業向けAI技術への投資が拡大しているものの、実際の利益化にはまだまだ時間がかかると報告されている。- OpenAIのChatGPT新バージョンで「冷たい対応」問題

ChatGPTの最新版ではユーザーとの感情的なつながりが弱まったため、迅速な修正が行われた。- 米国政府、IntelへのAI関連株式取引を検討中

米国はIntelにAI技術投資を加速させるため、株式参加を含む可能性が高いと報じられている。- 子供の写真投稿リスクがAIアプリで急増

AIが偽の写真やヌードを作成する可能性により、「シェアリング」のリスクが高まっている。- シリコンバレーが「ハードテクノロジー」時代へ

消費向けソフトウェアから、AIを基盤とした実用技術に移行中で、企業の注目が集まる。

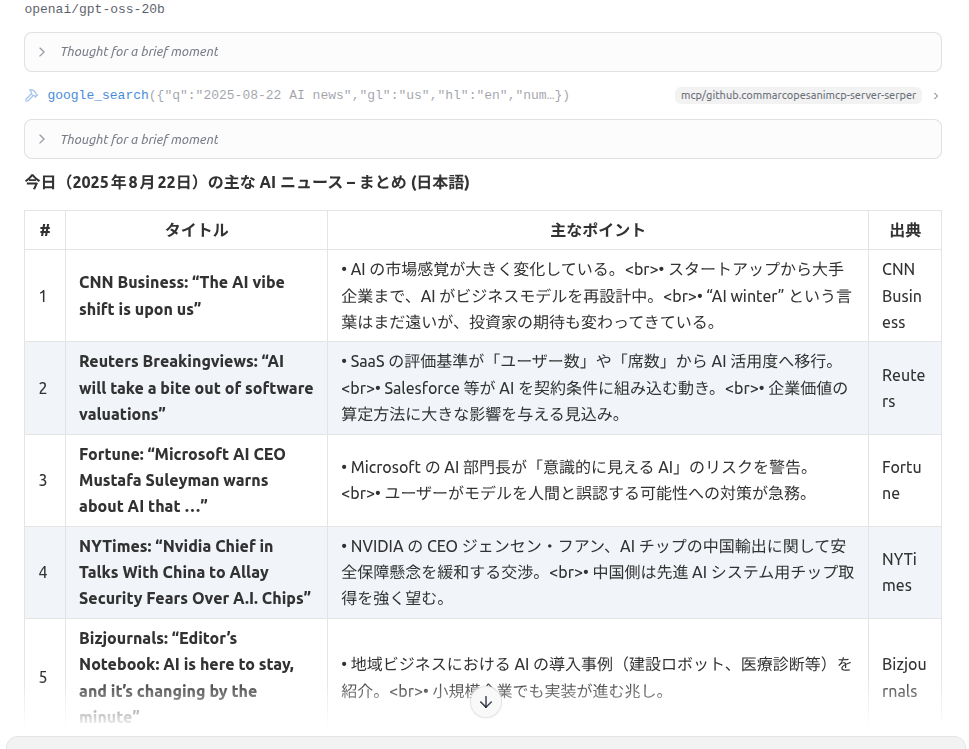

今度はモデルを変更して”openai/gpt-oss-20b”で試してみた。計測し忘れたがほぼ瞬時に回答が返ってきた。タイトルと主なポイントと出典をきちんと示してくれている。

感想

Jan-v1-4Bを使って試していた時は、回答までにかなり時間がかかっていたので、ローカルLLMで行う場合、マシン性能とネットワーク性能に依存するため仕方ないのかと思っていた。

試しに別のモデルのopenai/gpt-oss-20bで試したところローカルLLMでもClaude desktopのSonnet4で試した時と同じくらいの応答速度で回答が返ってきた。しかも回答のレベルが高くなっている。

これならローカルLLMのAIエージェントも十分使えそうだ。様々なモデルで試してみるのも面白そうである。ようやくAIエージェントが身近な存在になってきた。